浅析隐私计算与数据合规——随技术聊合规,用技术促合规

以下文章来源于国枫律师事务所 ,作者龚琳、潘凯文

隐私计算已经成为近期的热门话题,本文将从隐私计算的常见技术与其应用场景出发,浅析隐私计算中的数据合规问题,与大家聊聊如何通过隐私计算提升数据流通融合的合规效果。

作者:龚琳、潘凯文

2021年3月31日,北京国际大数据交易所成立,北京数据交易系统上线。作为国内首家基于“数据可用不可见,用途可控可计量”新型交易范式的数据交易所,北京数据交易系统是基于区块链和隐私计算技术支持的全链条交易服务体系,为市场参与者提供数据清洗、供需撮合、法律咨询、价值评估、权属认证等一系列专业化服务[1]。

2022年2月28日,广东省人民政府办公厅印发《广东省数字政府改革建设2022年工作要点》(粤办函[2022]24号)指出,“探索运用区块链、隐私计算等新技术强化数据安全防护”。

作为国内隐私计算领域的领军企业,华控清交信息科技(北京)有限公司参与了湖南大数据交易所的建立,为我国新型数据交易所提供了重要的技术支持[2];北京数牍科技有限公司为深圳数据交易所提供数据流通环节中的隐私计算技术平台支撑,同时还成为上海数据交易所首批签约数商、北京国际大数据交易所联盟首批成员单位[3]。

隐私计算,“火”起来了!

一、隐私计算为何“火”起来?

(一)日益增长的数据需求

大数据产业对数据最为渴求。2015年8月,国务院发布《促进大数据发展行动纲要》,指出“大数据持续激发商业模式创新,不断催生新业态,已成为互联网等新兴领域促进业务创新增值、提升企业核心价值的重要驱动力。大数据产业正在成为新的经济增长点,将对未来信息产业格局产生重要影响”。一些企业将大数据业务作为其主营业务,因为主营业务的定位而对海量数据有天然的渴求,充足的、有品质的、有价值的数据是一些企业赖以生存的基石。因此,对海量数据依赖强烈的企业,不仅希望通过自身主动直接地收集数据,也希望通过数据流通融合的方式从其他数据企业得到其数据需求的满足。

(二)日趋严苛的合规要求

隐私计算的出圈,和近年来全球在网络安全与数据合规方面趋严的监管规则密切相关。

2018年欧盟出台的《通用数据保护条例》(GDPR),成为全球数据安全领域的一部标杆性立法,带给企业高昂的合规成本;2020年生效的被称为美国最全面、最严厉的个人隐私保护法案《加利福尼亚消费者隐私法案》(CCPA),加强了对消费者隐私权和数据安全保护;2020年11月2日新加坡通过了《个人数据保护法》(PDPA)的重大修改,针对个人资料隐私引入更多新规定,其中包括企业将承担更多义务[4]。根据联合国贸易和发展会议的统计[5],在194个国家中已有137个国家制定立法以确保对数据和隐私的保护。

从2017年6月1日我国第一部网络空间安全管理的基石性法律《网络安全法》正式实施,《民法典》、《数据安全法》、《个人信息保护法》、《信息安全技术 个人信息安全规范》、《信息安全技术 个人信息安全影响评估指南》等一系列关于我国网络安全、数据合规、个人信息保护等相关法律法规、司法解释、标准指引等文件不间断地推出并紧锣密鼓地更新。相关法律法规高频地出台、一系列GB/T标准的陆续制定、逐渐增多的数据合规事件的曝光处罚,使网络安全、数据合规、个人信息保护受到了前所未有的关注。拥有数据资源的主体被戴上了牢牢的“紧箍咒”,以前将数据以明文方式简单粗暴进行共享的滥用数据、侵犯隐私等不法行径将受到严厉扼制。

(三)数据流通融合的信任缺失

互联网时代的数据大多以电子形式存在。电子数据极易被复制,且通常情形下复制成本极低。一旦被复制扩散,数据处理者就丧失了对数据的控制力。所以,在市场信用和信任机制尚未足够强健的情形下,越是具有含金量的数据,数据处理者对数据共享就越有顾虑,分享意愿也就越不强烈。再如,在数据融合场景,需要各数据处理者将彼此数据共享处理。然而每位数据处理者所拥有的数据可能在数据质量方面参差不齐,一旦明文共享,对于拥有优质数据的数据处理者而言就是另一种伤害。

(四)数据流通融合的引导支持

数字经济时代,各类数据迅猛增长、海量聚集。如果拥有大数据的主体(比如政府部门、互联网公司、网络运营商、金融/医疗/汽车等各类行业公司)不能将收集到的数据进行融合分享有效利用,那么数据的价值就无法得到充分挖掘。中共中央、国务院印发的《关于构建更加完善的要素市场化配置体制机制的意见》将数据列为生产要素,《数据安全法》提出要坚持“以数据开发利用和产业发展促进数据安全,以数据安全保障数据开发利用和产业发展”。一系列关于支持、引导、鼓励、推动数据流通的政策文件不断推出,合法合规地开发利用数据,将会为社会治理与发展带来巨大福祉,也给隐私计算赋能数据流通融合创造了时代机会。

因为日益增长的数据需求,因为日渐严苛的合规要求,因为数据处理者之间的信任顾虑,又因为各类引导支持文件的不断推出,还因为其他各个方面的相关因素,隐私计算迎来了难逢的发展机遇。

二、隐私计算技术与应用

隐私计算是什么?根据由隐私计算联盟、中国信息通信研究院云计算与大数据研究所于2021年7月联合发布的《隐私计算白皮书(2021年)》,隐私计算(Privacy-preserving computation)的定义是“在保证数据提供方不泄露原始数据的前提下,对数据进行分析计算的一系列信息技术,保证数据在流通和融合过程中的可用不可见”[6]。

通过以上定义可以知悉:

1. 隐私计算不是单一技术,而是一系列信息技术的统称

2. 隐私计算主要作用于数据流通和融合的过程

3. 隐私计算的核心竞争力是数据可用不可见

隐私计算最具代表性的是多方安全计算,由图灵奖获得者姚期智院士于1982年提出,至今已有40年。在隐私计算领域,另有联邦学习、可信执行环境为典型代表。隐私计算技术体系既包含混淆电路、不经意传输等底层密码学技术,也包含零知识证明、差分隐私等辅助技术。不同技术各有所长,在解决不同问题时所发挥的作用各有千秋,在具体应用场景中,往往根据问题需求、行业类别、数据规模等因素而选择隐私计算的不同技术结合使用。

(一)以多方安全计算为代表的基于密码学的隐私计算技术

多方安全计算(Secure Multi-Party Computation,MPC)由图灵奖获得者姚期智院士通过提出和解答百万富翁问题而创立:有两个百万富翁,想要比比谁更富有,但又不想让对方知道自己到底有多少财富,该怎么解决?多方安全计算是指“在无可信第三方的情况下,多个参与方共同计算一个目标函数,并且保证每一方仅获取自己的计算结果,无法通过计算过程中的交互数据推测出其他任意一方的输入数据(除非函数本身可以由自己的输入和获得的输出推测出其他参与方的输入)”[7]。

(二)以联邦学习为代表的人工智能与隐私保护技术融合衍生的技术

联邦学习(Fedetated Learning,FL)由谷歌于2016年提出,是“实现在本地原始数据不出库的情况下,通过对中间加密数据的流通与处理来完成多方联合的机器学习训练”[8]。联邦学习是“以一个中央服务器为中心节点,通过与多个参与训练的本地服务器交换网络信息来实现人工智能模型的更新迭代,即中央服务器首先生成一个通用神经网络模型,各个参与方将这个通用模型下载至本地并利用本地数据训练模型,将训练后的模型所更新的内容上传至中央服务器,通过将多个参与方的更新内容进行融合均分来优化初始通用模型,再由各个参与方下载更新后的通用模型进行上述处理,这个过程不断重复直至达到某一个既定的标准。在整个联邦学习的过程中,各参与方的数据始终保存在其本地服务器,降低了数据泄露的风险”[9]。

(三)以可信执行环境为代表的基于可信硬件的隐私计算技术

可信执行环境(Trusted Execution Environment,TEE)是一个隔离的执行环境,是通过软硬件方法在中央处理器中构建一个安全的区域,与其他应用和操作系统隔离开,使得操作系统和其他应用无法访问或更改该安全区域中的代码和数据,保证其内部加载的程序和数据在机密性和完整性上得到保护。目前主流的TEE技术以X86指令集架构的Intel SGX技术和ARM指令集架构的TrustZone技术为代表[10]。

(四)应用场景

1. 政务领域

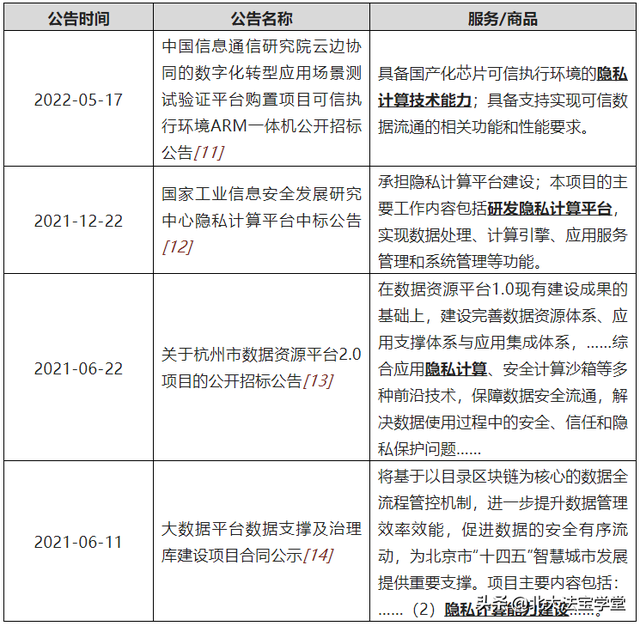

政务数据涉及的政府主管部门分散,涉及人口数据、消费数据、税务数据、交通数据等各种类型,“数据孤岛”情形比较严重。2021年3月发布的《中华人民共和国国民经济和社会发展第十四个五年规划和2035年远景目标纲要》提出要“持续深化政务信息系统整合,布局建设执政能力、依法治国、经济治理、市场监管、公共安全、生态环境等重大信息系统,提升跨部门协同治理能力”。2021年9月1日实施的《数据安全法》,更是制定了“政务数据安全与开放”的专章规定。于是,在“推动政务信息化共建共用”的规划要求下,近年来涉及隐私计算技术的政府采购项目逐渐增多。通过各采购平台公示信息检索,摘录列举部分政府机构、科研事业单位对于隐私计算产品和服务的需求:

2. 金融领域

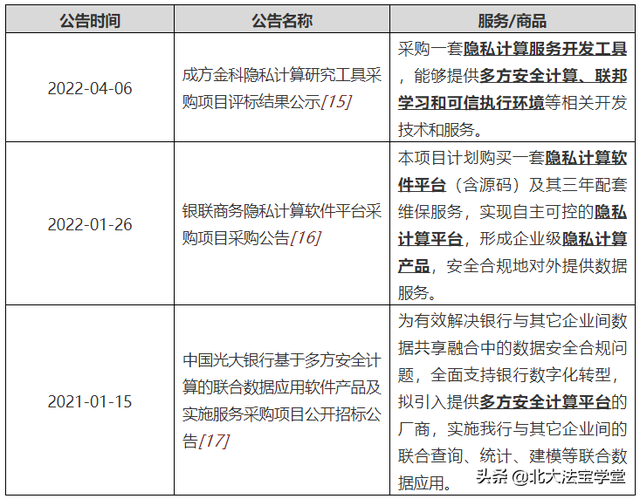

银行、保险等金融机构由于其主营业务特点,往往收集存储海量数据,尤其涵盖了大量个人敏感信息,所以金融数据的安全防范一直是关注的重点。通过引入隐私计算技术,在金融机构之间进行联合查询、统计、建模等联合数据应用,可以在信贷评估、供应链金融、精准营销等方面进行合作,在严守合规底线的基础上实现数据的共享融合。通过各采购平台公示信息检索,摘录列举部分金融机构对于隐私计算产品和服务的需求:

3. 医疗领域

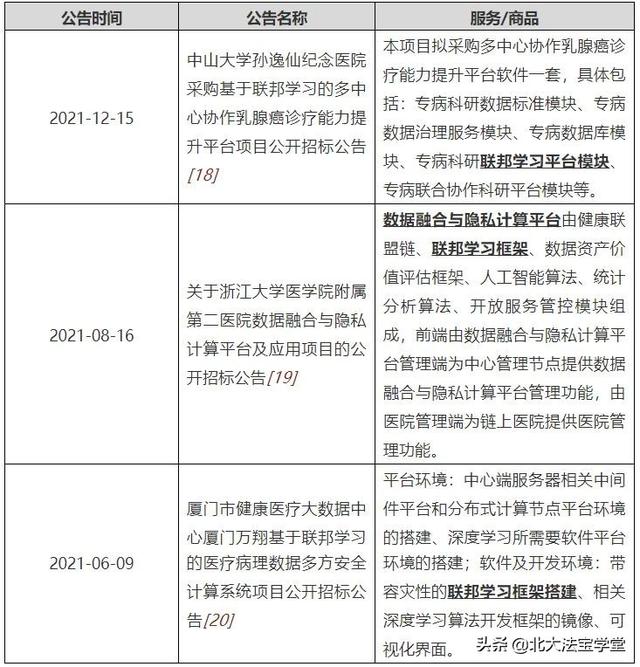

医疗健康领域涉及大量个人敏感信息,需要执行严格的隐私保护。为了卫生防疫、医疗科研、药物研发等公共管理、学习研究或商业目的,都需要海量医疗健康数据作为支撑,对于数据融合共享的迫切需求自然不言而喻。通过各采购平台公示信息检索,摘录列举部分医疗领域对于隐私计算产品和服务的需求如下:

综上所述,隐私计算已在政务、金融、医疗健康等合规要求严格的领域有了丰富的应用场景。把有含金量的数据解放出来,把优质数据的价值释放出来,隐私计算技术逐渐成为落地实现的关键一环。

三、隐私计算与数据合规

(一)助力之举

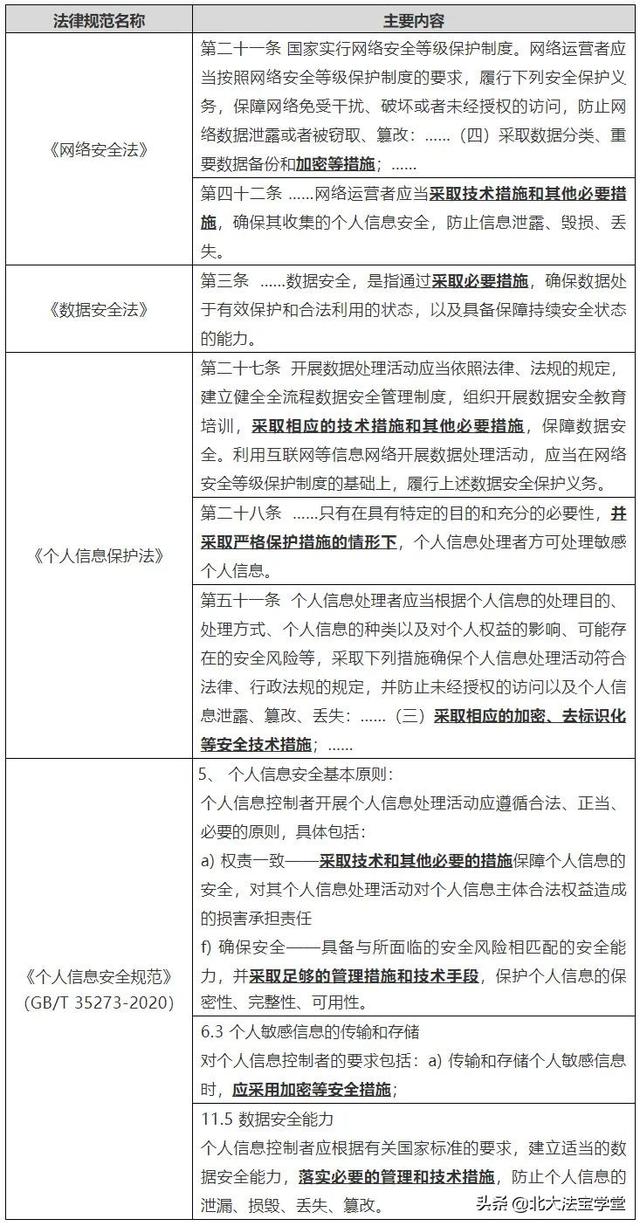

隐私计算有助于网络运营者、数据处理者、个人信息处理者履行自身的法定义务。

前文说到,隐私计算是一系列信息技术,是“数据可用不可见”的实现方案和保障措施。所以,如果网络运营者、数据处理者、个人信息处理者根据不同的应用场景将合适的隐私计算技术运用其中,也就在一定程度上证明其已履行和承担了前述法律法规等文件对其提出的义务和责任。

(二)无奈之处

隐私计算的核心竞争力是数据在流通和融合过程中的“可用不可见”,但使用隐私计算并不意味着可以解决数据流通融合的所有合规问题。

例如,隐私计算技术的使用仍需面对数据来源的合法性问题。数据流通融合往往涉及多方主体参与,前文提及的多方安全计算、联邦学习等隐私计算技术的应用场景,都涉及多方数据处理者提供相应数据。通常情形下,根据各方职能划分,隐私计算参与方可分为“数据提供方”、“技术提供方”和“结果使用方”三方。数据来源的合法性是对数据提供方提出的最为关键的合规要求。无论是直接收集的数据(数据提供方直接向数据主体进行收集),或者间接获取的数据(数据提供方向数据供应商采购的数据),或者自身生产经营活动所产生的商业数据,亦或对收集数据进行梳理汇总所形成的衍生数据,如果在隐私计算技术启用的起点,数据提供方的数据来源没有遵循“合法、正当、必要的原则,公开收集规则,明示收集信息的目的、方式和范围,并经被收集者同意”,没有限于“实现处理目的的最小范围”,存在瑕疵甚至不法,那么后续计算的过程、计算的结果都将面临侵权的指责和责任的承担。

再如,隐私计算的使用仍需面对数据使用的合法性基础。就个人信息的处理而言,合法性前提是取得个人同意,或者符合《个人信息保护法》第十三条规定的几项无需取得个人同意的法定情形。如个人信息已经匿名化处理后不再属于个人信息的范畴,则应转而适用《数据安全法》等关于数据方面的使用合规要求。此外,《个人信息保护法》中规定了个人信息处理者自行处理及涉他处理(共同处理、委托处理、共享)的不同情形,不同情形的法定义务大不相同。例如,委托处理情形无需对数据主体告知同意,而共享情形下(即个人信息处理者向其他个人信息处理者提供其处理的个人信息的情形)应当向个人告知接收方的名称或者姓名、联系方式、处理目的、处理方式和个人信息的种类,并取得个人的单独同意,如果接收方变更原先的处理目的、处理方式的,还应当依法重新取得个人同意。通常情形下,在使用阶段最主要的合法性基础是授权同意,即在授权同意的范围内合法正当地使用数据,不得超越授权。由此可见,作为隐私计算的数据提供方,其提供的数据究竟能否使用、可以怎样使用、应当在怎样的范围内使用,不同的应用场景下,在不同的使用方式下,得出的答案可以大不相同。所以,在采用隐私计算技术方案时,仍需重点关注数据的使用授权。如果数据主体明确不同意数据的流通融合,那么数据提供方即使确保了数据来源的合法性(数据主体同意其采集),即使因为隐私计算“数据可用不可见”的核心竞争力大幅降低了数据泄露风险和数据主体权益的侵害可能,但也无权将数据用于流通融合。

除此之外,之于个人信息的合规,还包括在数据使用过程中对个人信息主体的响应如何实现,以及在非匿名化个人信息的数据交互后,如何有效的实现数据生命周期末端——包括个人信息主体请求以及法律规范所要求的数据删除及监控日志等问题,需要相关主体在隐私计算设计中即充分考虑此类合规问题并加以实现。同时,在隐私计算的过程中存在包括个人信息主体、数据提供方、技术提供方、结果使用方等在内的多方主体,发生合规风险时,相关主体之间的责任如何划分界定,也需要在实践中不断探寻各方主体权责在法益上的相对平衡。

(三)规范发展

隐私计算作为可以促进数据流通融合的有效技术方案,迎来一波市场热潮。无论是互联网大厂还是隐私计算初创企业,入局者都在努力助推技术的发展创新,努力和众多产业、具体应用场景进行融合对接。但是,入局者们的技术成熟度参差不齐,不免对隐私计算产品和技术的推广造成一定的困扰。为在一定程度上解决产品和服务的标准化问题,隐私计算相关标准的制定和更新迭代近年来持续不断。

2020年11月,中国人民银行发布《多方安全计算金融应用技术规范》(JR/T 0196-2020)金融行业标准,该规范由全国金融标准化技术委员会归口管理,由中国人民银行科技司提出并负责起草,并最终通过全国金融标准化技术委员会审查;2021年3月30日,国际标准组织电气与电子工程师协会(IEEE Standards Association)通过确认联邦学习架构和应用规范的标准P3652.1(Guide for Architectural Framework and Application of Federated Machine Learning),并发布正式标准文件(IEEE P3652.1)[21];2021年11月,国际标准组织电气与电子工程师协会正式发布了多方安全计算IEEE国际标准——《IEEE2842-2021 - Recommended Practice for Secure Multi-Party Computation》[22];2022年4月15日,国家市场监督管理总局、国家标准化管理委员会发布《信息安全技术 可信执行环境 基本安全规范》,确立了可信执行环境系统整体技术架构,描述了可信执行环境基础要求、可信虚拟化系统、可信操作系统等主要内容及其测试评价方法;近日,中国信息通信研究院联合中国互联网金融协会中互金认证颁发了我国首张“联邦学习产品安全认证证书”,通过权威认证助力金融隐私计算高质量发展。

国际标准组织电气与电子工程师协会、中国信息通信研究院、全国信息安全标准化技术委员会、各行业主管部门、隐私计算领域的产品和服务入局者、隐私计算联盟以及其他努力推动隐私计算实现其产品和服务价值的各类机构、组织和个人,都在积极参与相关国际、国家、行业标准的研究制定,期望通过标准的制定来规范隐私计算领域的有序发展。

四、总结与展望

数字经济离不开海量数据的流动融合。数据合规边界不应无限扩张,数据流通融合也不应无序发展。

虽然隐私计算产品和服务所产生的合规效果尚未得到司法实践的判例检验,但是在全面推进数字化转型的政策引领下,在促进数据流通融合的时代背景下,我们期待隐私计算技术作为先进技术代表,作为合规保障措施,以其不断拓展的更为广泛的应用场景实践,努力推动数据合规边界的动态平衡。

评论