NUS团队开发实景技术,加强医疗急救培训

近日,Keio-NUS CUTE中心研究人员开发多感官扩展现实(MS-XR)医疗危机管理系统,可为医疗急救人员提供更真实的培训体验。其模块化设计支持扩展到更多的伤亡类型,从而扩大这一创新的实际应用。

研究背景

在大规模伤亡事件中,医疗急救人员及时根据受害者的伤势严重程度进行分类是至关重要的。这些应急人员提供实景培训,可以帮助他们更好地为应对此类危机做好准备。

然而,现实生活中的大规模伤亡模拟演习需要大量的计划、人力、时间和空间。与实体演习相比,虚拟现实(VR)模拟演习可以帮助缓解所需的资源量。

但大多数VR模拟涉及使用游戏控制器的点击操作,或者它们只是为用户提供一个没有交互性的事件的视觉模拟。这些虚拟模拟缺乏刺激认知和肌肉记忆的直接和自然的触觉互动。

针对这些传统培训方法的局限性,NUS智能系统研究所(NUS Smart Systems Institute)下属的Keio-NUS CUTE中心的研究人员与新加坡武装部队(SAF)一起开发了多感官扩展现实(MS-XR)医疗危机管理系统,为医疗急救人员提供更真实的分诊培训体验。

该危机管理系统已被用于SAF医疗培训学院(SMTI)的医疗分诊培训模块。SMTI使用新的培训方法培训了其紧急医疗技术员学员,这些学员的反馈是积极的。SMTI计划每年为其在SAF各单位的所有学院和毕业生使用新的培训模块。

连接物理和虚拟空间

该系统的核心是MS-XR中间件平台——一个将虚拟现实与有形的多感官硬件界面结合起来的软件。在MS-XR医疗危机管理系统中,中间件将物理智能人体模型与虚拟模拟的伤员联系起来,在物理和虚拟元素之间建立同步响应。

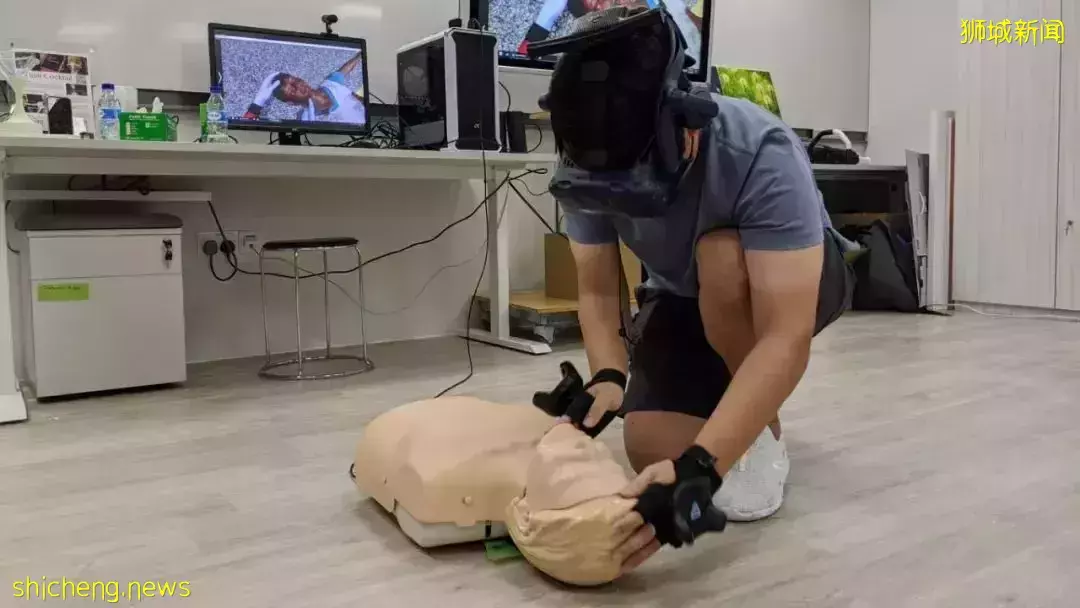

使用该系统,受训者能够进行救生干预并与伤员进行互动,就像他们在现实中一样。这包括进行分流评估,如检查呼吸、脉搏和精神状态,以及气道重新定位。

这些互动是在一个智能人体模型上进行的,该模型由智能传感器和触觉设备开发,以重现处理伤员的实际感受。

用户还戴上专有的追踪手套,为虚拟模拟提供触觉反馈,而不需要另一个中间控制器。另一方面,模拟会显示伤员的生命体征,如脉搏。

在智能人体模型上检查脉搏的动作(右)被映射到虚拟现实

模拟(左),显示出伤员的生命体征,来源:NUS

学员从一开始就沉浸在一个真实环境中。他们被要求在虚拟场景中快速移动,同时对伤员进行有效的分流评估。每次模拟演习结束时,学院都会得到及时的评估,并记录下他们行动的细节,以便分析和汇报。

该中间件能够将嗅觉、味觉、热量和气流等其他感官整合到虚拟现实模拟中,从而可能提供更逼真的训练情境。有了既定的中间件,培训内容也可以很容易地扩展到更多的伤亡类型,而不需要改变任何硬件。

身临其境的分诊培训体验,来源:NUS

创造真实世界的影响

为表彰这种提高学习成果的创新方法,MS-XR医疗危机管理系统在2021年12月沃顿-QS Reimagine教育奖中获得了“虚拟/增强现实”类金奖。

Keio-NUS CUTE中心联合主任,NUS设计与工程学院的 Yen Ching-Chiuan 副教授表示:“这个医疗危机管理系统建立在Keio-NUS CUTE中心现有的多感官模拟系统和装配工作的基础上。”

他说道:“我们与SMTI密切合作,设计了一个高度适用于他们的人员的培训场景。鉴于我们的MS-XR中间件的可定制性,我们期待着扩大这一创新的实际应用。”

Keio-NUS CUTE中心正在寻求与SMTI进一步合作,开发为个人和团队能力提供核心医疗技能培训的系统,包括为院前护理场景开发基于MS-XR的培训。

评论